骨伝導イヤホン、スマートグラス、AI作曲……『ウェアラブルEXPO』が示す、エンタメの未来

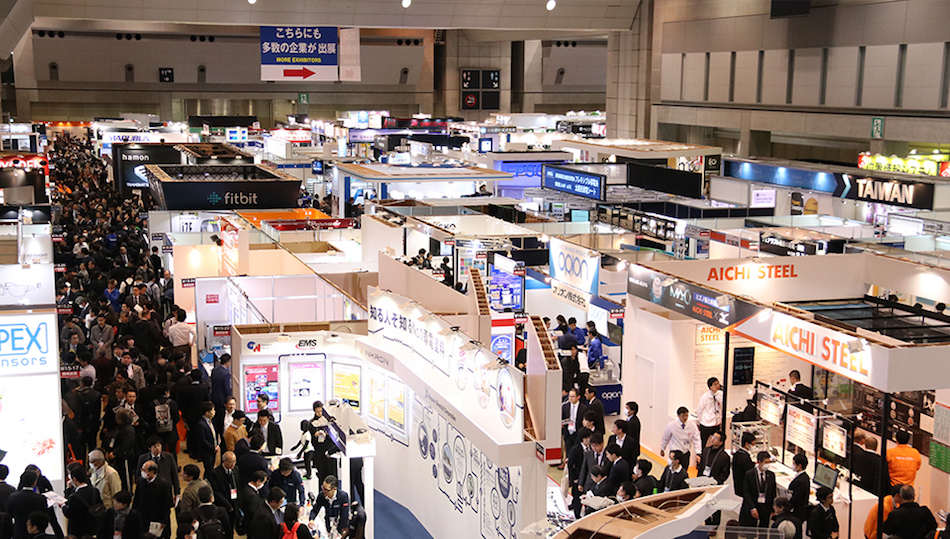

1月17日から1月19日まで東京ビックサイトで開催された、最新のウェアラブルデバイスが集まる『第4回ウェアラブルEXPO』。AR、VRのヘッドマウントディスプレイやスマートグラス、ヘルスケアデバイス、高機能繊維など、商談向けの展示会やカンファレンスが行われた。今回編集部では1日目にあたる17日に参加。本稿ではその模様をレポートする。

骨伝導技術で自由に音楽を楽しむイヤホン&スピーカー

BoCoのブースで展示していたのは骨伝導技術を使用したイヤホン「EarsOpen」と手のひらサイズのスピーカー「docodemoSPEAKER」だ。イヤリングの様に装着する「EarsOpen」は耳を塞がずに音楽を楽しめるなんとも変わったデバイス。周りの音が聞こえるので会話をしながらでも、通勤通学中でも安全に音楽を楽しむことができる。また鼓膜ではなく骨伝導のイヤホンのため、難聴者も音楽を聴くことが可能だ。「docodemoSPEAKER」はテーブルや壁面、窓、車の車体など取り付けられる場所があれば振動によってどこでも、なんでもスピーカーになってしまうというデバイスだ。コンパクトな見かけによらず高出力でざわついた会場内でもはっきり聞こえるくらいのボリュームだった。こちらはクラウドファンディングを経て量産が既に決まっており、2~3月に19,800円で発売予定だ。

新たなコミュニケーションツールの登場、リアルタイム翻訳機

富士通が発表したのは音声認識翻訳ソフト「LiveTalk」とスマートグラス「MOVERIO」を用いたリアルタイム翻訳スマートグラスだ。MOVERIOのグラスの向こう側に翻訳映像が投影され、リアルタイムに相手が言っていることが文字化、さらに翻訳化される。WEBを繋ぐとクラウドと連携でき、AIが学習しどんどん賢くなり、特殊な言葉も辞書登録すればすぐに変換してくれる。MOVERIO自体もかなり軽量化されており、普段使いも支障がなさそうだった。ただ投影された映像が少し遠く感じ、壁など平らな面に投影された映像を当てないと見えにくいため、舞台やセミナーの翻訳であれば問題なさそうだが、相手と対面しながら話す時など日常使いはまだ難しいと感じた。

AIが奏でるミライの自動作曲音楽大阪大学の研究

グループ・大阪大学センター・オブ・イノベーション(COI)研究推進機構のブースでは「音楽による人間の活性化」に取り組む研究グループが「brAIn Melody(ブレイン・メロディ)」を展示。これは体験者に色々な曲を聴いてもらい、音楽を聴いている時の脳波を計測。そのデータを元にAIが体験者の感情と楽曲の関係を学習し、作曲してくれるというもの。体験者にとってリラックスできるものや嬉しい気分、悲しい気分などシチュエーションによって最適な音楽を生成。実際にフォークデュオ・ワライナキと共同で曲を発表している。「AIとぼく」はAIとは何かをわかりやすく歌にしたもので、メロディ自体は単調ではあるもののボーカルが入ることによりポップな雰囲気の曲となっている。