スマホの次のデバイスは“AIメガネ”か Google、Metaを筆頭に2026年は競争激化の兆し

ここ数年、「スマホの次は何か?」という問いに対して、有力候補として挙げられることが増えていたのがAIメガネだ。耳元にスピーカーとマイク、フレームにカメラを配置し、クラウド上の生成AIと常時接続することによって、目の前の景色を理解しながら対話できる環境が立ち上がりつつある。本稿では、「AIメガネは本当に“スマホの次”になり得るのか?」という問いを軸に、2026年に向けて動き始めた各社の戦略を整理していく。

なぜ今“AIメガネ”なのか?

背景として押さえておきたいのは、生成AIの性能向上と、小型カメラや省電力チップの進化が同時並行で進んだことだ。手元の画面を凝視し続けるスマホ体験に対して、「ながら」で使えるインターフェースへの関心も高まっている。通知の確認やナビゲーション、簡単な検索といった用事なら、ポケットから端末を取り出すよりも、AIに気軽に話しかけて済ませたい。そうした小さなニーズの積み重ねがAIメガネというデバイスの需要を高めている。

GoogleはGeminiとAndroid XRで再挑戦へ

そうしたなかで注目を集めたのが、12月9日のGoogleによる開発中のAIメガネの発表だ。かつて同社はGoogle Glassで先行したものの、デザインやプライバシーへの懸念から一般消費者向けには広がらなかった。今回はその反省を踏まえ、Warby ParkerやGentle Monsterといったアイウェアブランドと組み、日常的に利用するメガネとしてのデザインを前提に据えている。

今回のAIメガネは、音声とカメラを備えた「AI Glasses」と、レンズ内にも情報を表示する上位版「Display AI Glasses」の2カテゴリが想定されている。どちらも基盤となるのは、ヘッドセットとメガネを統一的に扱う新プラットフォーム「Android XR」と、マルチモーダル対応の大規模モデル・Geminiだ。ユーザーが見ている看板や商品をカメラが捉え、その文脈をGeminiが理解したうえで翻訳や説明を返す。そうした体験を、できるだけ自然な会話のかたちで提供しようとしている。

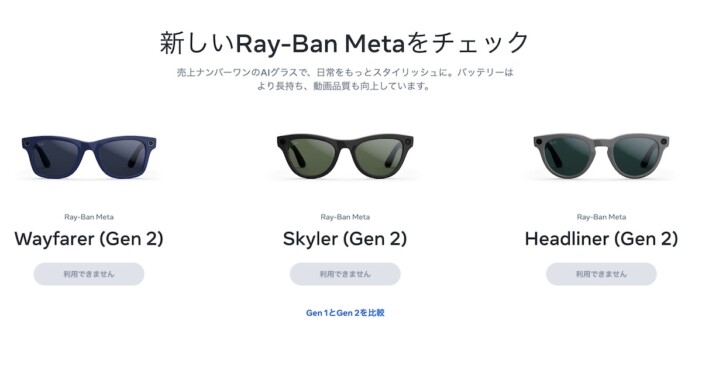

先行するMetaのRay-Ban Meta

一方、すでに市場で存在感を示しているのがMetaのRay-Ban Metaシリーズだ。サングラス型のフレームにカメラとスピーカーを組み込み、音声で呼びかければ「Meta AI」が写真撮影や情報検索に応じてくれる。SNSとの連携も含め、すでに実用可能なAIメガネとして先行者優位を確保している。

Metaは将来的にはより本格的なMRグラスも視野に入れつつ、当面はRay-Banブランドとの協業を軸に“日常使いできるAIメガネ”を磨き込んでいくと見られる。GoogleがOSとAIの統合で勝負するのに対して、MetaはSNSとエンタメのエコシステムを手元に持つ。この違いが、2026年前後の戦い方に影響を与えるだろう。

AIメガネは“スマホの次”になり得るか?

では、AIメガネはどこまでスマホの役割を肩代わりできるだろうか。現時点で想定されているユースケースは、ナビゲーションや通知の確認、短いメッセージの送受信、リアルタイム翻訳、写真・動画の記録、会議や授業の要約といった領域だ。これらは画面をじっと見続けるよりも、視界と音声に自然に溶け込んだほうが使いやすい場面が多い。「ちょっとした用事はメガネで、それ以外はスマホやPCで」という役割分担が、現実的な落としどころになりそうだ。

同時に、課題も少なくない。常時カメラとマイクが稼働し得るデバイスである以上、周囲の人を含めたプライバシーの設計は避けて通れない。一日中かけていられる軽さとバッテリー持続時間、そして日常使いのメガネとして受け入れられる価格帯をどう実現するかも、各社共通のハードルだ。

それでも、2026年はGoogleとMetaを筆頭に、AIメガネをめぐる本格的な競争が始まる年になるだろう。数年後、当たり前のようにAIメガネをかけた人々が街を行き交っているのか。2026年は、その未来を占う重要な一年となりそうだ。

ロボットが品出し、従業員はスマートグラスを着用……KDDIとローソンがAI活用で店舗業務を変える実証について発表

KDDIはローソンと協力してAIを活用した施策について実証していることを発表した。本記事では3つの実証を取り扱う。 AIとロボ…