Xが「AIで生成」ラベルを導入 武力紛争により早くも浮き彫りになった“自己申告制”による課題

生成AIが作り出すコンテンツのクオリティは急速に上がっている。その一方で、2026年に入ってからだけでも「Grok」による性的ディープフェイク画像の大量生成や「Seedance 2.0」で実在の俳優を使ったディープフェイク動画が問題視されるなど、トラブルが立て続けに起きている。

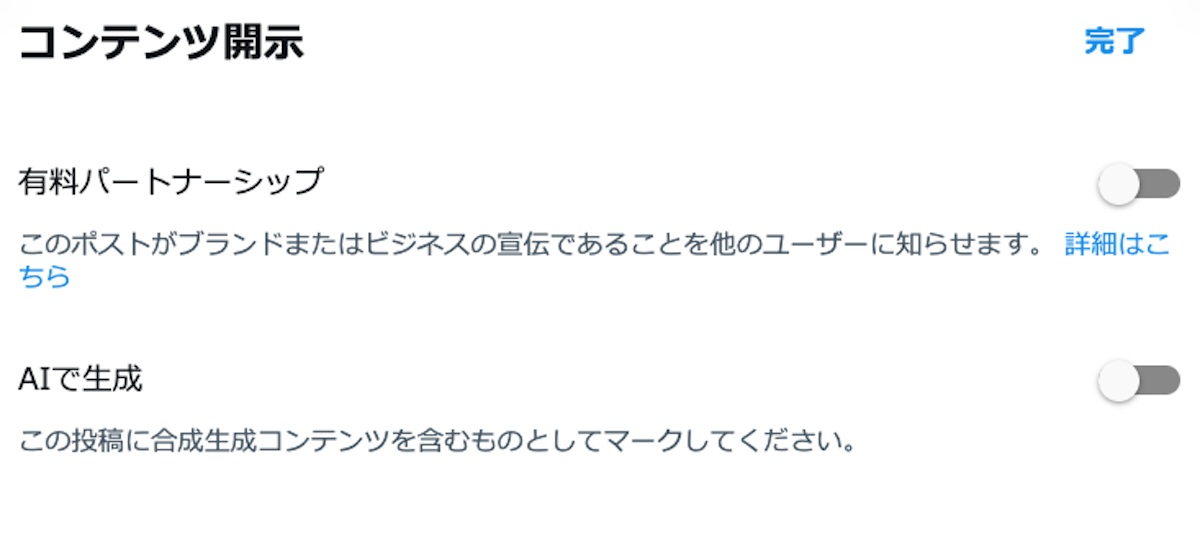

こうした中、Xは3月1日ごろ、投稿に「AIで生成」というラベルを表示させる「コンテンツ開示」機能を導入した。この機能はかねて噂されていたものだ。対象は、AIでゼロから生成した画像や動画はもちろん、既存の素材をAIで大幅に加工・改変したコンテンツも含まれるとみられている。使い方はシンプルで、投稿画面のメニューから設定を有効にするだけだ。

BREAKING: 'Made with AI' labels are now live on X.

It will help users quickly see what is AI generated and what is real, making it much harder for fake images and videos to mislead the public. pic.twitter.com/DgwRQAfI14

— DogeDesigner (@cb_doge) February 28, 2026

実効性はユーザーのモラルとリテラシー次第

ただし、現時点でラベルの表示はあくまで任意だ。AI生成コンテンツであることの開示は義務化されておらず、ラベルを付けるかどうかはユーザーの判断に委ねられている。

そのため、「ラベルを表示せずに悪質なAI生成コンテンツを発信する悪質なユーザーにはどう対応するのか」という課題も残る。これはXのコミュニティノート(ユーザー同士がファクトチェック情報を付記する機能)が抱える問題とも共通する。この点について海外テックメディアのTechweezは、こうした仕組みの実効性はユーザーのモラルとリテラシーに委ねられてしまうという構造的な弱点を指摘。ラベルを付けなかったクリエイターがルール違反に問われる可能性に触れ、「この仕組みが任意のままでいられる時間は長くない」と述べている。

アメリカ・イスラエルとイランの武力紛争、AI生成の偽映像が大量拡散

このように現状はユーザーのモラルとリテラシーに基づく構造のため、導入当初から強制力を伴うルール整備が今後の焦点になるとみられていたが、この懸念は早くも現実のものとなった。AIラベル表示機能の導入直後、アメリカ・イスラエルとイランの武力紛争をめぐってAI生成の偽映像がX上に大量拡散する事態が発生。Xの製品責任者のニキータ・ビア氏は3月4日、急きょ同社がクリエイター収益分配ポリシーの改訂を行なったことを発表した。新しいポリシーでは、ラベルなしで武力紛争関連のAI生成動画を投稿したユーザーに対して、90日間の収益分配停止措置を実施する。加えて、その後も違反が続いた場合は、収益分配を永久停止するという。

Today we are revising our Creator Revenue Sharing policies to maintain authenticity of content on Timeline and prevent manipulation of the program.

During times of war, it is critical that people have access to authentic information on the ground. With today’s AI technologies,…

— Nikita Bier (@nikitabier) March 3, 2026

しかし、この措置もクリエイター向けの収益化プログラムの参加者にしか効力がなく、収益化を目的としていないアカウントにとっては抑止力になり得ないという指摘がある。自己申告制のラベル表示やコミュニティノートによる事後チェック、そして今回の収益化の停止といった対策も、結局はいずれもユーザーのモラルや経済的な動機に依存する仕組みだ。情報戦やトロール行為を目的にAI生成コンテンツを使って偽情報を拡散する層には届きにくいという構造的な課題が残る。

そもそもプラットフォーム側がAI生成コンテンツを自動で検知する技術も、まだ発展途上だ。GoogleはAI生成コンテンツに電子透かし「SynthID」を導入し、MidjourneyやStable Diffusionもそれぞれ独自の透かし技術を導入しているが、各社の技術に互換性はなく、プラットフォーム側が横断的にAI生成コンテンツを検知できる統一的な仕組みはまだ存在しない。また、AI生成の痕跡を除去する技術的な手段も存在するなど、あらゆるAI生成コンテンツを検知できる仕組みは、業界全体としてもまだ確立されていない。

AIが加速させるポスト・トゥルースの時代

SNSではかねてからファクトチェックの重要性が叫ばれてきた。特に"ポスト・トゥルース"という言葉が広く知られるようになって以降、その傾向は顕著だ。それにもかかわらず、SNSユーザーのリテラシーが大きく改善したとは言い難いのが現状だろう。むしろ、AIによる精巧な画像や動画の登場により、何が事実で何がフェイクかの判断はさらに困難になっている。ポスト・トゥルースがAIというテクノロジーを得て形を変え、進化した、いわば"ポスト・トゥルース2.0"とも呼べる状況だ。

今回の「AIで生成」ラベルの導入は、コンテンツがAIによるものかどうかの境界線を明確にするという点では確かに一歩前進だ。しかし、先述したような構造的な課題を抱えている以上、プラットフォームや技術だけに解決を求めるのは現状では難しい。近年のAIの加速度的な発展により、AI生成コンテンツが当たり前に流れてくる時代は予想よりも早く到来した。だからこそ、それを受け取る側のユーザー一人ひとりが「この情報は本物か」と立ち止まる意識を持つことが、これまで以上に重要になっているのではないだろうか。

参考:

https://gigazine.net/news/20260225-x-ai-labels/

https://news.yahoo.co.jp/expert/articles/3187acaca3fecb60f49fd13902bf3e6955bd87ec

https://techweez.com/2026/03/02/x-rolls-out-made-with-ai-label-puts-disclosure-pressure-on-creators/

https://www.niemanlab.org/2026/03/x-will-demonetize-users-who-post-ai-generated-videos-of-war-but-not-other-kinds-of-disinformation/

https://deepmind.google/models/synthid/