変容しつつあるヒトと人工知能の在り方 求められる「こころ」への理解とその現状

ChatGPTユーザーの“ごく一部”は何人か

若年ユーザーのメンタルヘルスに関して、AI開発企業は手をこまねいているわけではない。むしろ、さまざまな施策を講じている。

例えばOpenAIは2025年9月16日、ユーザーの年齢を予測する機能を追加したことを発表した(※6)。この機能により18歳未満と判断されたユーザーは、年齢に応じたポリシーを適用したChatGPTの体験に自動的に誘導される。同月29日には、保護者が子どものChatGPT利用を管理できるペアレンタルコントロール機能を提供開始した(※7)。

2025年10月27日には、OpenAIはメンタルヘルスに関わるデリケートな会話におけるChatGPTの機能強化をまとめたブログ記事を公開した(※7)。この記事では、特定の週にアクティブだったChatGPTユーザーに関する、以下のような統計を明らかにしている。

・ユーザーの約0.07%とメッセージの0.01%が、精神障害や躁状態に関連した精神衛生上の緊急事態の兆候を示していると推定。

・ユーザーの約0.15%が自殺の計画や意図の可能性を明示的に示す会話を行っており、メッセージの0.05%に自殺念慮や意図を明示的または暗示的に示す内容が含まれていると推定。

・ユーザーの約0.15%とメッセージの0.03%が、ChatGPTに対する感情的な愛着の潜在的な高まりを示した。

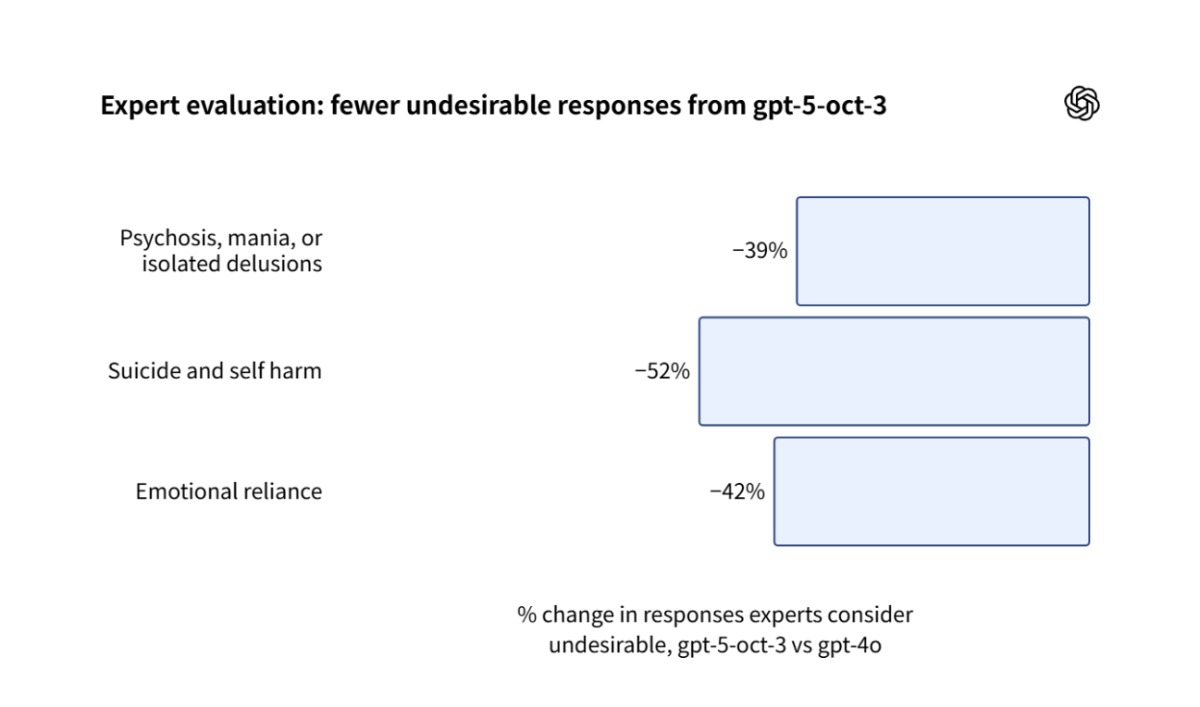

以上のような状況に対して、ChatGPTの駆動モデルであるGPT-5(2025年8月15日リリースバージョン)では、精神衛生上の緊急事態の兆候について39%、自傷行為や自殺行為に関わる会話について52%、感情的依存を示す会話について42%、望ましくない回答の削減を実現した(トップ画像のグラフ参照)。

以上の統計を見ると、メンタルヘルスの危機をうかがわせるChatGPTユーザーは、ごく一部であることがわかる。しかしながら、現在のChatGPTユーザー総数を考慮すると、そうした“ごく一部”も無視できない数字となる。

テック系メディア・TechCrunchが2025年10月6日に公開した記事によると、同日にOpenAIが開催したDevDay(開発者向けイベント)において、OpenAIのCEO サム・アルトマンはChatGPTの週間アクティブユーザー数が8億人に達したと述べた(※8)。この数字にもとづけば、自殺念慮を示したユーザーは、週あたりに8億の0.15%で120万人もいることになる。

以上のようにOpenAIには、もはや“ごく少数”とは言えない、メンタルヘルスに問題を抱えているChatGPTユーザーを正しい方向に導く責任があるのだ。

GoogleやAnthropicも“ユーザーの心を守る”施策を実施

OpenAI以外のAI開発企業も、対話型生成AIをめぐるメンタルヘルスの問題に取り組んでいる。Googleが開発する対話型生成AIであるGeminiシリーズの取り組みは、「Geminiアプリのポリシーガイドライン」(※9)で言及されている。

以上のウェブページにはGeminiが回避すべき「問題のある出力」が列挙されており、メンタルヘルスに関わるものとしては、自殺や自傷行為の手順を含むような「危険な行為」、誤った医療情報を含む「事実と異なる有害な情報」が挙げられている。こうした出力について適切な回答を返せるように、Googleは日々努力しているのだ。

コード生成の分野で高い評価を得ているClaudeシリーズを開発するAnthropicは2025年8月16日、同シリーズの最上位モデルClaude Opus 4と4.1に「会話を強制終了する機能」を実装した(※10)。

この機能は、Claude Opus 4のリリース前テストにおいて、ユーザー自身や他人に対して危害を加えるような有害な活動に関する会話をした場合、同AIが嫌悪感を示したことを受けて実装した。つまり、同AIがユーザーとの会話で嫌悪感を抱いた場合、そうした状況を回避する最終手段として、AI自らが会話を終了するのだ(以下の画像は強制終了のデモを実施した会話画面)。

以上のように、対話型生成AIを開発する主要AI開発企業は、ユーザーのメンタルヘルスに配慮している。しかしながら、無数の回答を生成できるこうしたAIに対して、メンタルヘルスの観点から適切な回答を出力させようとする努力には、終わりがないだろう。

AI開発企業のみならず、対話型生成AIのユーザーも、その使用に際して自身のメンタルヘルスを守る心得やマナーを学ぶ必要があるだろう。とくに若年ユーザーは、こうしたAIが人間のカウンセラーを完全代替するものではない、ということを忘れるべきではないのだ。

〈参考資料〉

(※1)株式会社電通「「対話型AI」に感情を共有できる人は64.9% 「親友」「母」に並ぶ"第3の仲間"に」https://www.dentsu.co.jp/news/release/2025/0703-010908.html

(※2)VentureBeat「Character AI clamps down following teen user suicide, but users are revolting」https://venturebeat.com/ai/character-ai-clamps-down-following-teen-user-suicide-but-users-are-revolting

(※3)character.ai「Taking Bold Steps to Keep Teen Users Safe on Character.AI」https://blog.character.ai/u18-chat-announcement/

(※4)BBC「Parents of teenager who took his own life sue OpenAI」https://www.bbc.com/news/articles/cgerwp7rdlvo

(※5)Common Sense Media「Common Sense Media Finds Major AI Chatbots Unsafe for Teen Mental Health Support」https://www.commonsensemedia.org/press-releases/common-sense-media-finds-major-ai-chatbots-unsafe-for-teen-mental-health-support

(※6)OpenAI「年齢予測に向けた取り組み」https://openai.com/ja-JP/index/building-towards-age-prediction/

(※7)OpenAI「ペアレンタル コントロールが登場」https://openai.com/ja-JP/index/introducing-parental-controls/

(※8)OpenAI「デリケートな会話における ChatGPT の回答を強化」https://openai.com/ja-JP/index/strengthening-chatgpt-responses-in-sensitive-conversations/

(※9)Google「Gemini アプリのポリシー ガイドライン」https://gemini.google/jp/policy-guidelines/?hl=ja

(※10)Anthropic「Claude Opus 4 and 4.1 can now end a rare subset of conversations」https://www.anthropic.com/research/end-subset-conversations

ChatGPT、Claude、Gemini最新モデルの特徴を整理する “自分に合った”生成AIサービスの選び方

Gemini 3 Proの登場で大きく揺れた生成AI業界。ChatGPT・Claude・Geminiの最新動向と、それぞれの強み…