もはや人間はAIを見抜けない? NVIDIA『GTC 2026』で披露された生成AIの“最前線”

3月16日から19日にかけて、アメリカ・カリフォルニア州のサンノゼで、GPU製造最大手のNVIDIAが主催する、AIをテーマにした世界最大級のカンファレンス『GTC 2026』(※1)が開催された。

本稿では、同カンファレンスで行われた950のセッションのなかから、2026年のAI業界におけるトレンドである「AIエージェント」と「フィジカルAI」の活躍を伝えるものを紹介する。さらに、ゲーム生成AIと動画生成AIといった「グラフィックAI」の最前線を知るのに役立つ、2つのセッションも紹介したい。

基本タスクを組み合わせて複雑なタスクを実行するクリエイティブ向けAIエージェント

NVIDIA所属のリック・シャンパン(Rick Champagne)氏とアシュリー・マルティーノ=ター(Ashlee Martino-Tarr)氏は、クリエイティブ部門におけるAIエージェント活用について発表した(※2)。

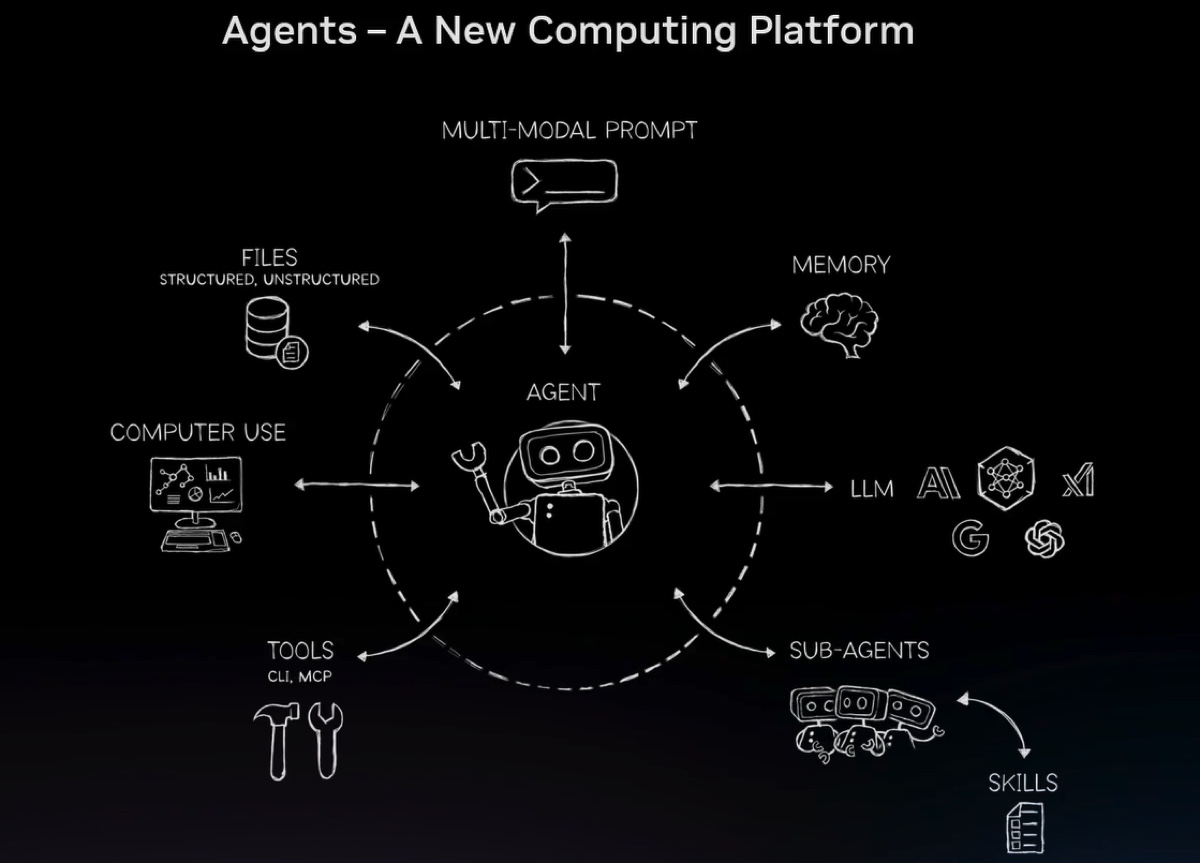

はじめにシャンパン氏は、最近の生成AIが“ユーザーと言葉でやり取りするだけ”の言わば「話し相手」から、ファイルにアクセスしてタスクを実行するような「AIエージェント」へと急速に進化していることを指摘した。

こうした傾向は今後も続き、AIエージェントはユーザーの仕事や日常生活をサポートする同僚や執事のような存在になるだろう、とも同氏は述べた。

続いて登壇したター氏は、クリエイティブ部門におけるAIエージェント活用の具体例について話した。同氏によると、こうしたAIエージェントは、テキスト生成や画像生成など、従来の生成AIのタスクを統合して複雑なタスクを実行することで、クリエイターを支援する。

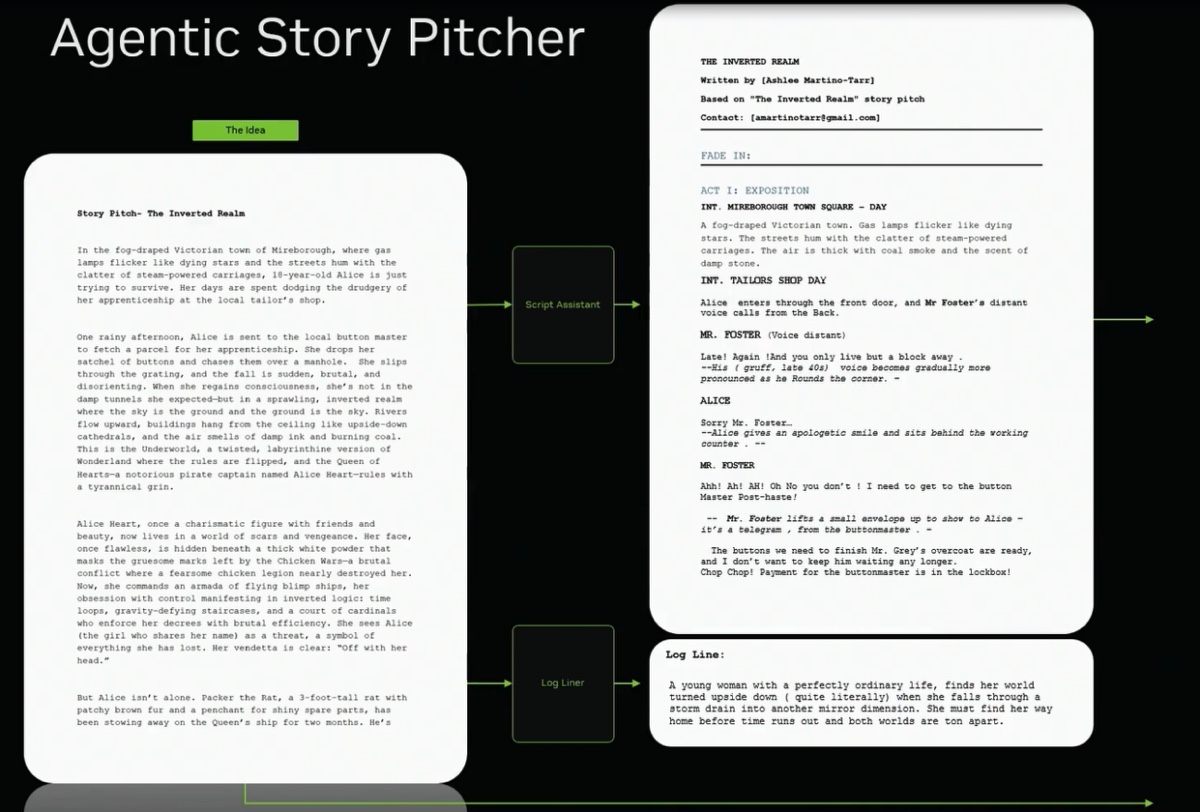

ター氏は、クリエイティブ部門におけるAIエージェント活用の具体例として、NVIDIAが研究している複数の映像制作支援AIエージェントを紹介した。ひとつめは、映像作品のアイデアを脚本とログライン(3行以内で書かれた要約文)に変換するストーリーボード・ピッチャーである。

このAIエージェントは、映像作品に関するアイデアを段落分けして書いた文書から、登場人物やイベントなどを抽出して簡単な脚本を生成するとともに、脚本のログラインを出力する。

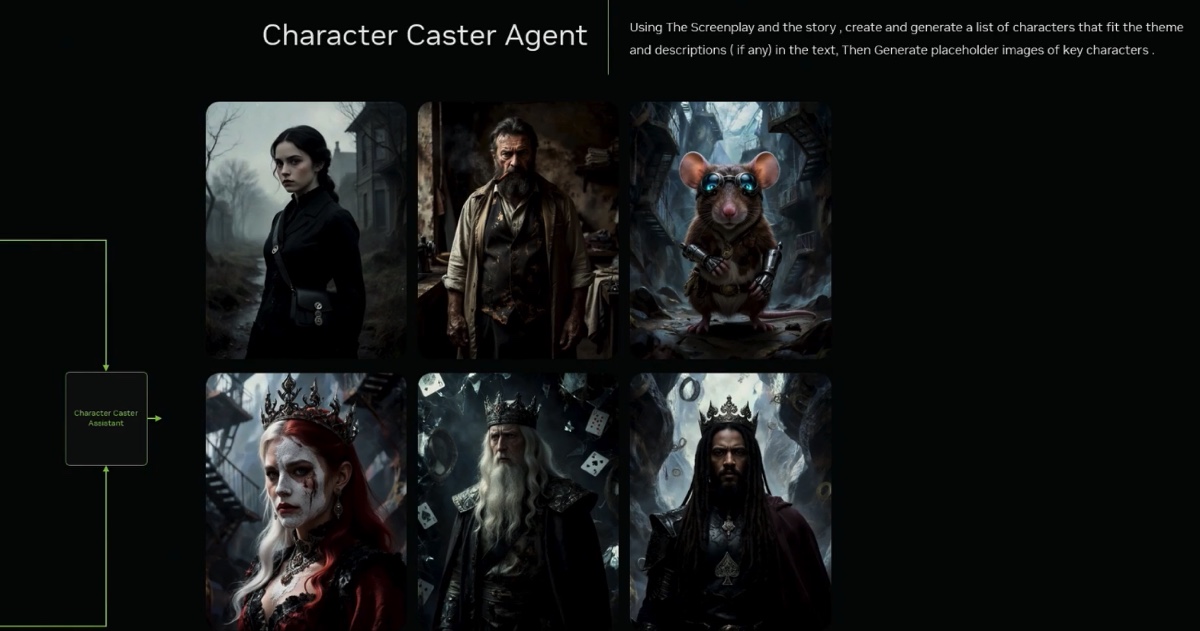

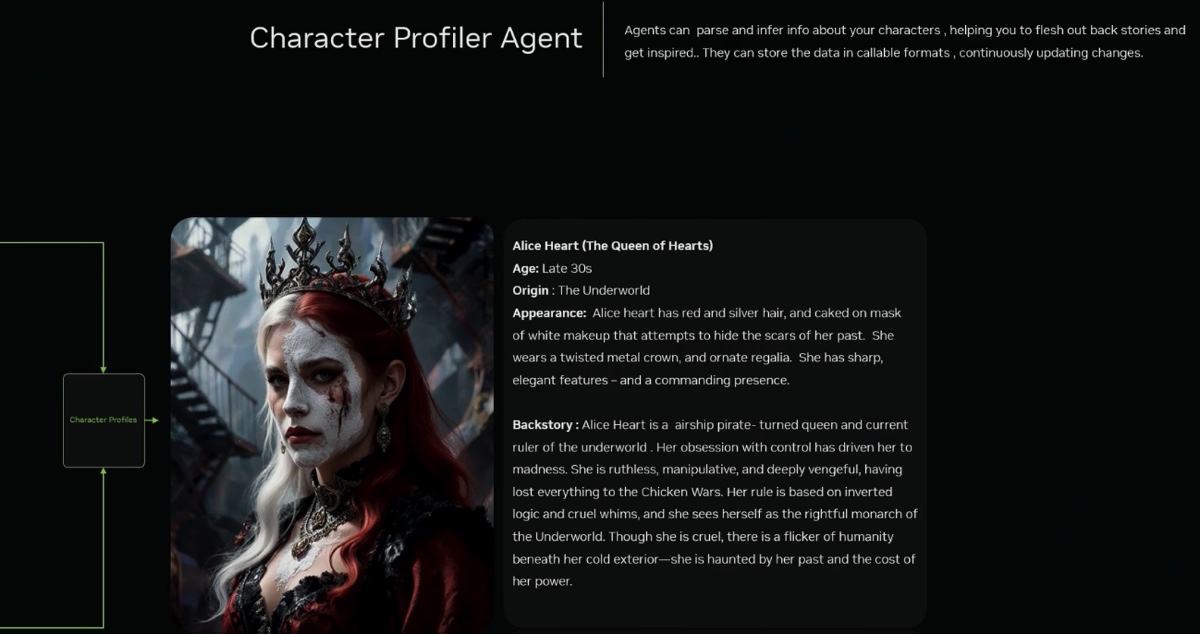

脚本の生成後に活用されるのは、キャラクター・キャスター・エージェントとキャラクター・プロフィーラー・エージェントだ。前者は、脚本から登場人物の情報を抽出したうえで、それらの画像を生成する。後者は、各登場人物の特徴や背景をまとめた文書を出力する。

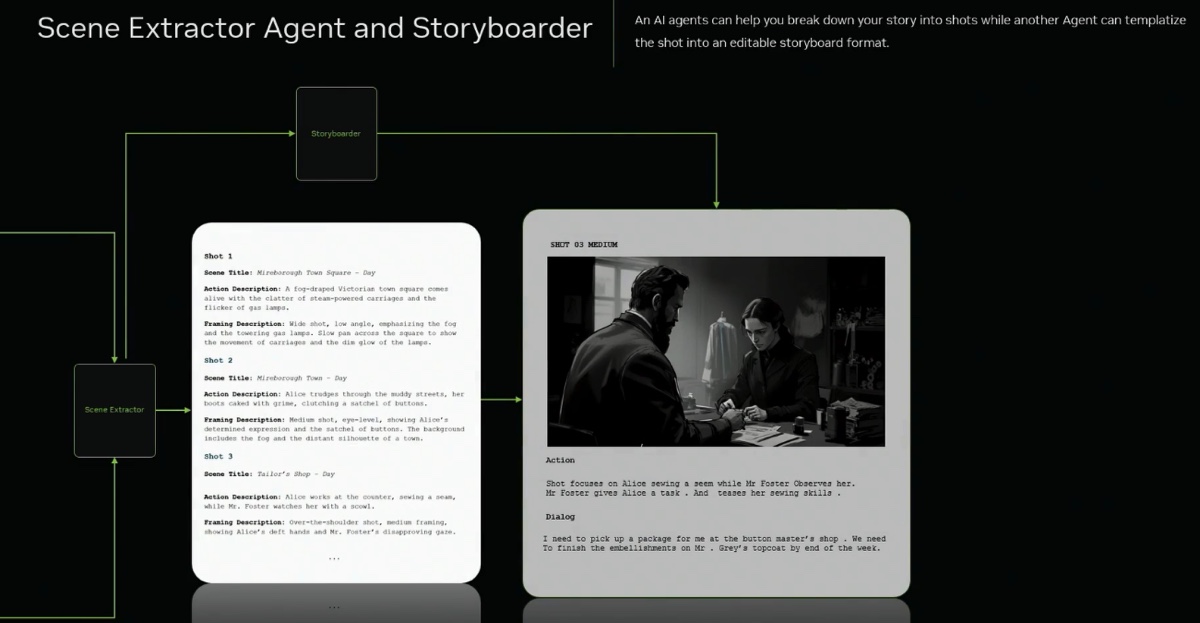

登場人物が整理されたら、次に活躍するのがシーン・エクストラクター・エージェントとストーリーボーダー・エージェントである。前者は、脚本と登場人物の情報にもとづいて、各シーンの内容を要約する。後者は、要約された各シーンに関する画像を生成して、ストーリーボードを作成する。

ター氏は、以上のようなAIエージェントのほかにも、3Dオブジェクト編集エージェントや動画編集エージェントなどを紹介した。紹介されたAIエージェントに共通するのは、従来はクリエイターの膨大な手作業で行っていたタスクを効率化するところにある。

膨大な手作業から解放されたクリエイターは、映像作品の作風や登場人物の掘り下げのよう な、よりクリエイティブな意思決定に専念できるようになる。クリエイティブ部門におけるAIエージェントは、クリエイターの仕事を奪うのではなく、彼らを“よりクリエイティブにするもの”として普及するだろう。

サプライチェーン全体に実装されるフィジカルAI

ドイツに本社を置くテクノロジー企業 Körber(ケルバー)傘下で、サプライチェーン技術を開発・提供するKörber Supply Chain所属のアントニオ・コンデ(António Conde)氏は、同社におけるフィジカルAI活用について発表した(※3)。

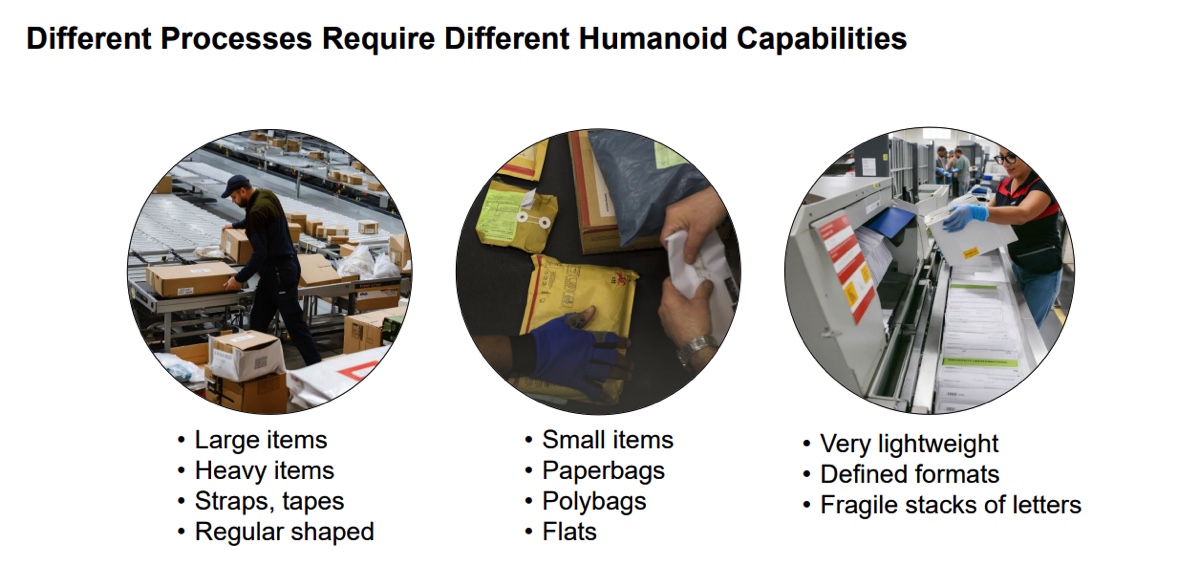

はじめにコンデ氏は、Körber Supply Chainが扱っている貨物の種類について話した。同社が扱う貨物には、大きくて重い大型貨物、紙で包装された小型貨物、そして文書などを包装する軽量貨物がある。同社は、これらをその大きさや壊れやすさに応じて仕分けするロボットを導入している。

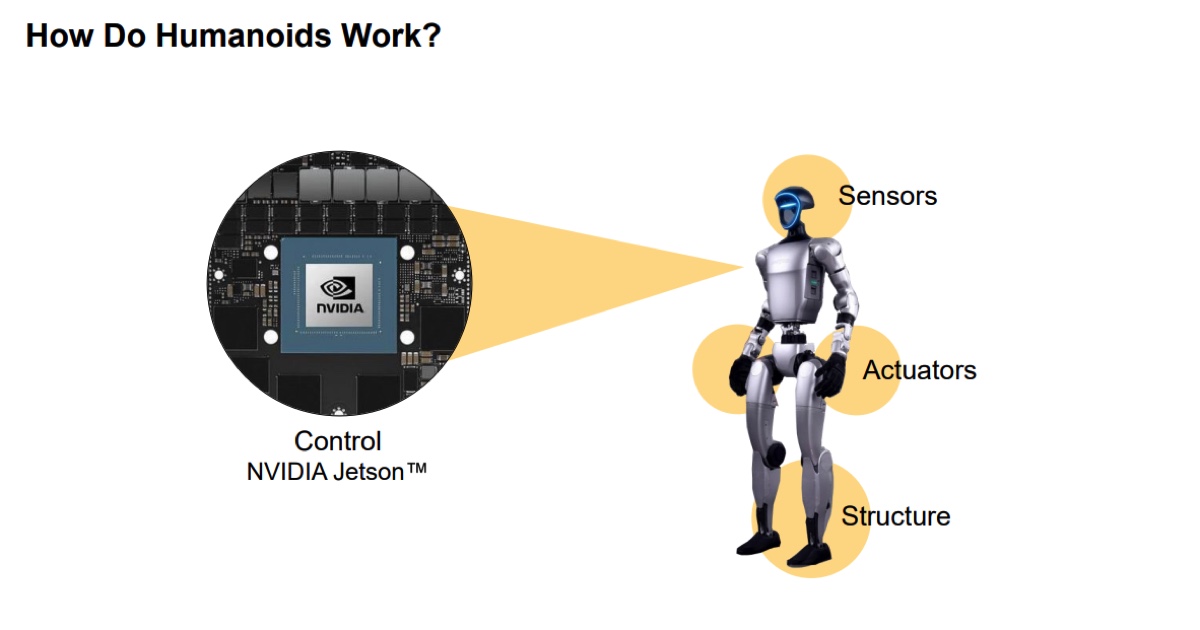

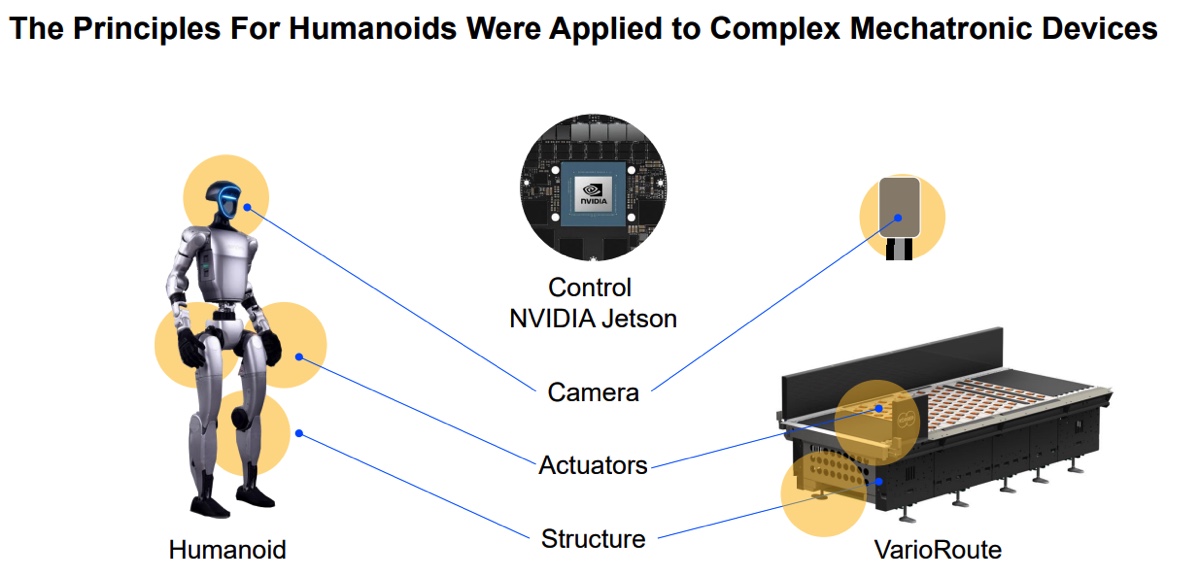

仕分けロボットは、貨物を識別するセンサー、手足を動かす関節に相当するアクチュエーター、そして、ロボット本体を支えるボディに相当するストラクチャーから構成されている。ロボットの知能を司るセンサーには、NVIDIAのAIチップが活用されている。

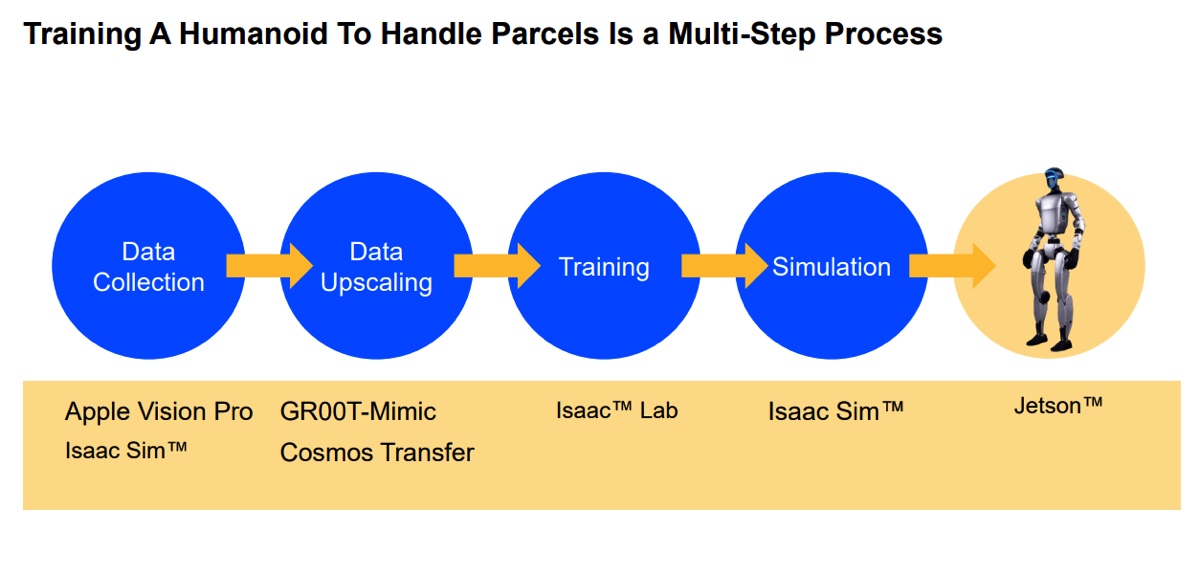

仕分けロボットが貨物の仕分けが出来るようになるには、仕分けに関する訓練が必要となる。こうした訓練を実施するために、貨物の識別と貨物の仕分け動作がセットとなった訓練データを収集する。仕分けロボットは、シミュレーション環境で訓練データを用いて仕分けを学習後、現場に投入される。

Körber Supply Chainは、ヒューマノイドロボット(ヒト型ロボット)のほかにも、貨物を識別したうえで自動的に搬送先を分けるダイバーター(押し出し装置)にもフィジカルAIを実装している。ダイバーターはヒューマノイドロボットとほぼ同等の構造をもっており、貨物を識別するカメラ、貨物を仕分けるアクチュエーター、そしてダイバーター自体を支えるストラクチャーから構成される。

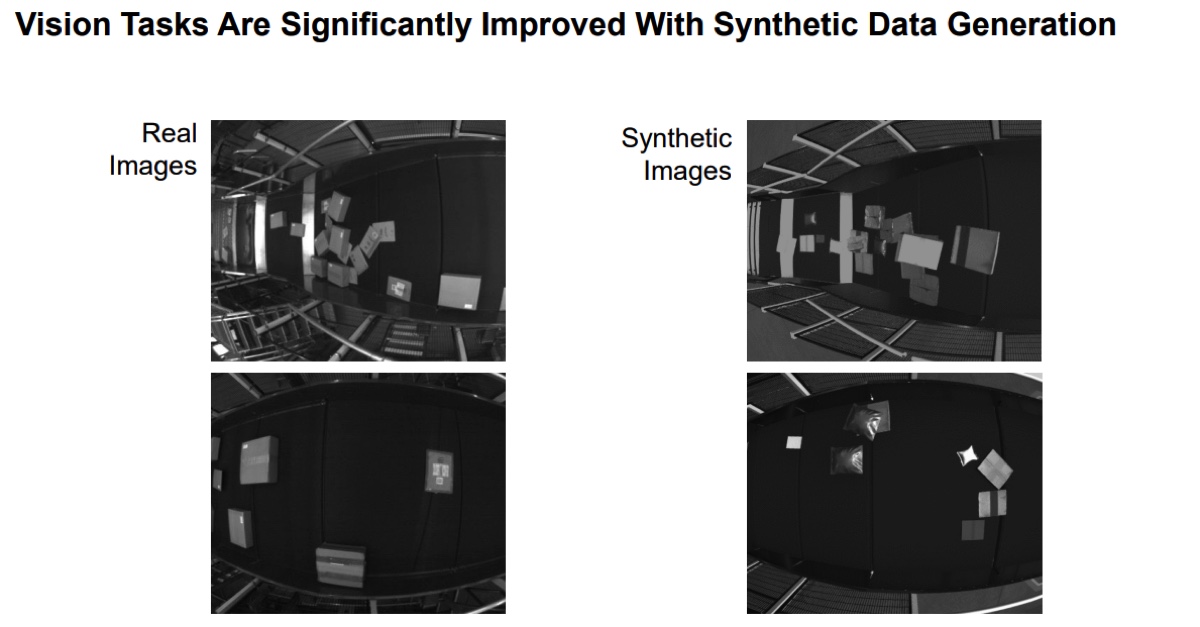

ダイバーターにも、貨物を仕分ける訓練を実施する。そうした訓練には、実際の貨物に関する画像データだけでは足りないので、実際の画像データを加工した合成データも用いる。

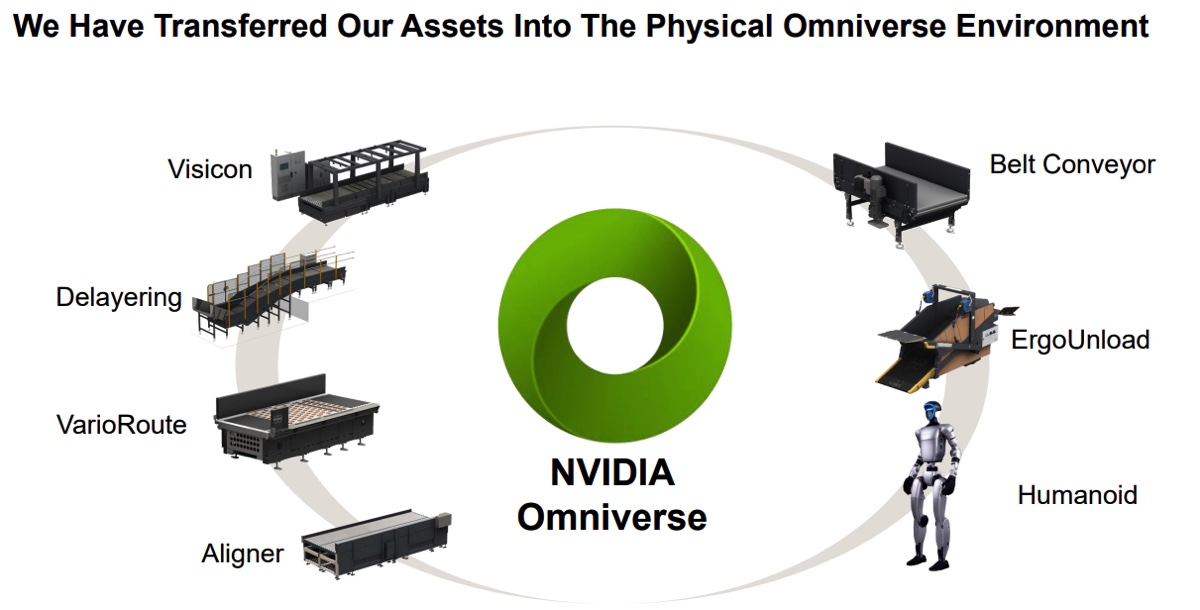

Körber Supply Chainはヒューマノイドロボットやダイバーター以外にも、サプライチェーンを構成するあらゆる機器にフィジカルAIを実装している。それらの機器の訓練には、NVIDIAが提供するシミュレーションツール「NVIDIA Omniverse」によって、構築されたシミュレーション環境が活用されている。

個々のサプライチェーン機器に関するシミュレーション環境をつなげると、サプライチェーン全体のシミュレーション環境が構築できる。こうした実在のサプライチェーン全体を反映したものは、いわゆる「デジタルツイン(デジタル的双子)」と呼ばれる。

サプライチェーン全体のデジタルツインがあることで、搬送プロセス全体の改善や保守作業などが容易になった、と述べてコンデ氏は発表を締めくくった。

ゲーム開発者から「作業」を減らし、クリエイティブワークを増やす

AIスタートアップ Decart所属のイーサン・ピーターセン(Ethan Petersen)氏と、NVIDIA所属のバヴァニ・ゴパラクリシュナ・ラオ(Bhavani Gopalakrishna Rao)氏およびアレックス・ダン(Alex Dunn)氏は、ゲーム生成AIについて発表した(※4)。

ピーターセン氏は、Decartの紹介から発表を始めた。同社は2024年10月、ゲーム生成AI「Oasis」を発表して一躍注目を浴びた。このAIは、Minecraftのゲーム画面を連続的に生成する、というものだった。

テキスト入力から3Dワールドを生成するGoogle DeepMindのゲーム生成AI「Genie 2」より2ヶ月早くリリースされたOasisは、わずか3日でプレイしたユーザーが100万人に達した。ChatGPTが100万人のユーザーに使われるのに5日を要したことと比較すると、Oasisの注目度の大きさがわかるだろう。

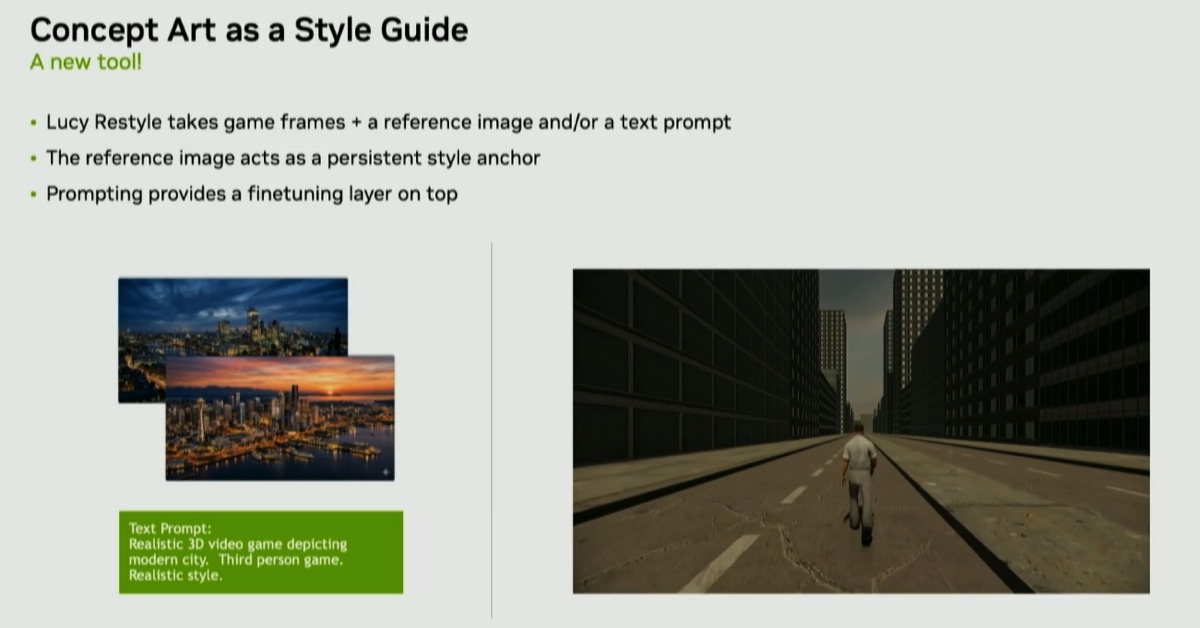

DecartはOasisをリリースした後、2025年7月にはゲーム画面全体をテキストプロンプトによって書き換えられる「Lucy Restyle」、2026年1月にはゲーム画面の編集が可能な「Lucy 2」を発表している。Lucy 2を使えば、ゲーム画面内のキャラクターのグラフィックを変更できる。

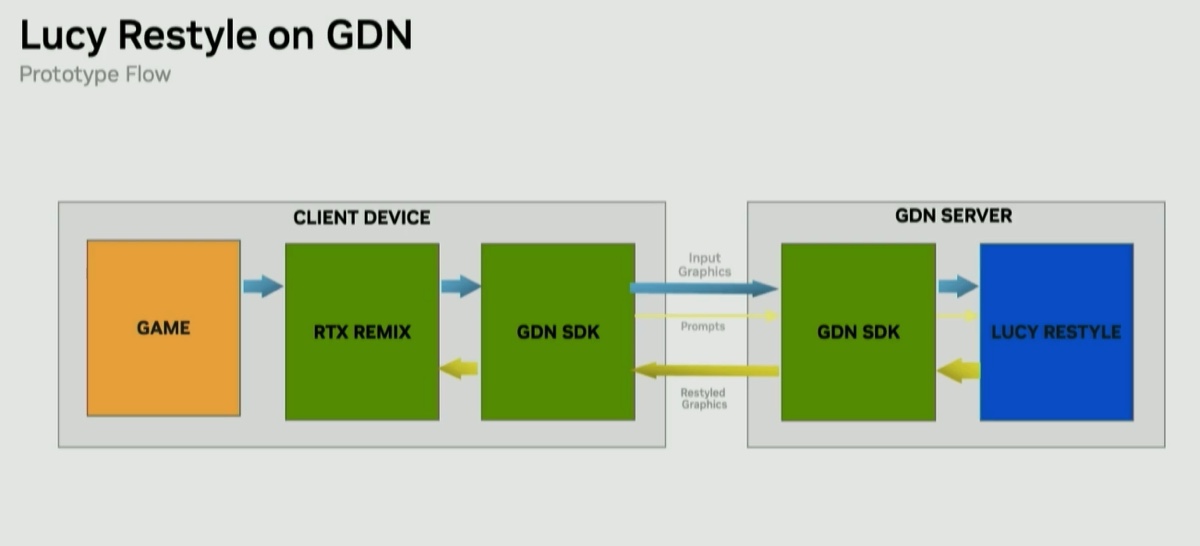

Decartのゲーム生成AIの運用には、NVIDIA製品が活用されている。続いて登壇したラオ氏は、Lucy Restyleの仕組みについて話した。同AIにおけるゲーム画面の生成には、グラフィックを低遅延で生成する「GDN(Graphics Delivery Network)」が使われている。また、ゲーム画面の出力には、名作ゲームのMod制作のために開発されたRTX REMIXが流用されている。

最後に登壇したダン氏は、生成AIのゲーム開発への応用について話した。広大なゲームフィールドと多数のオブジェクトから構成される現代の大作ゲームでは、ゲームのアートスタイルを試行錯誤することは極めて困難である。

こうしたなか、ゲーム生成AIを活用すれば、ゲームのアートスタイルを簡単に変更できる。例えば、現代が舞台のゲームのビジュアルをSF風に簡単に変更できる。このようにゲーム生成AIは、ゲーム開発者をよりクリエイティブワークに専念させるポテンシャルを秘めているのだ。

撮影動画と生成動画の区別をつけられる人間は10%未満?

動画生成AIのGenシリーズを開発・提供するRunwayのCTOを務めるアナスタシス・ゲルマニディス(Anastasis Germanidis)氏は、Genシリーズの現状と未来について発表した(※5)。

ゲルマニディス氏は、Genシリーズがバージョンを重ねるごとに高品質な動画を生成できるようになった歴史から話をはじめた後、同シリーズに最近実装された機能に言及した。その機能とは、リアルタイム動画生成である。

従来はテキストプロンプトを入力後、数秒から数十秒の動画が生成されるまでに数十秒の生成時間を要していた。こうしたなかRunwayは、テキストプロンプト入力直後から生成動画を出力することに成功した。この機能により、テキストプロンプトを入力して動画を編集するリアルタイム編集が可能となった。この技術には、NVIDIA Vera Rubin プラットフォームが活用されている。

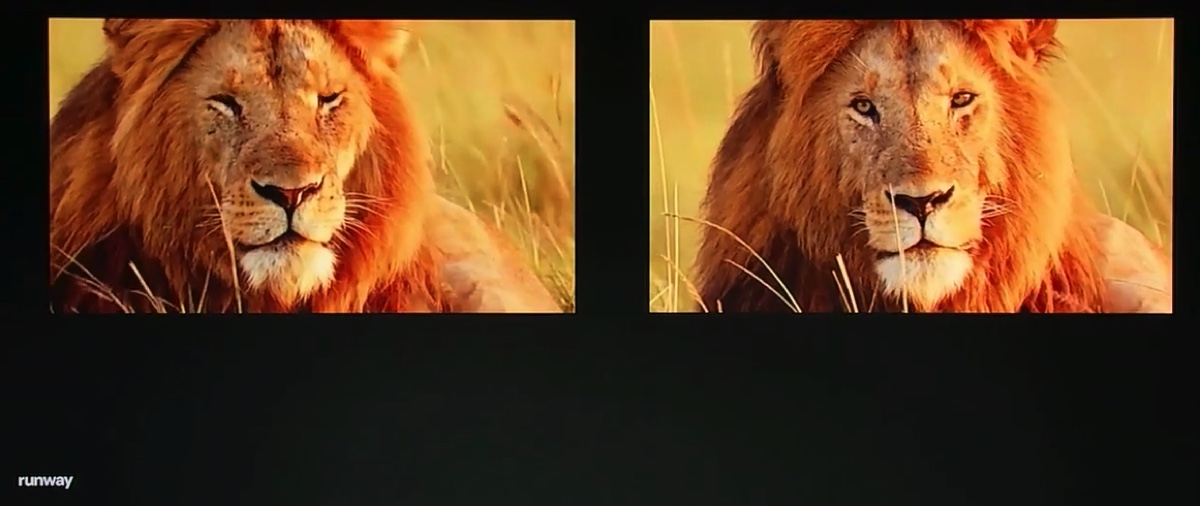

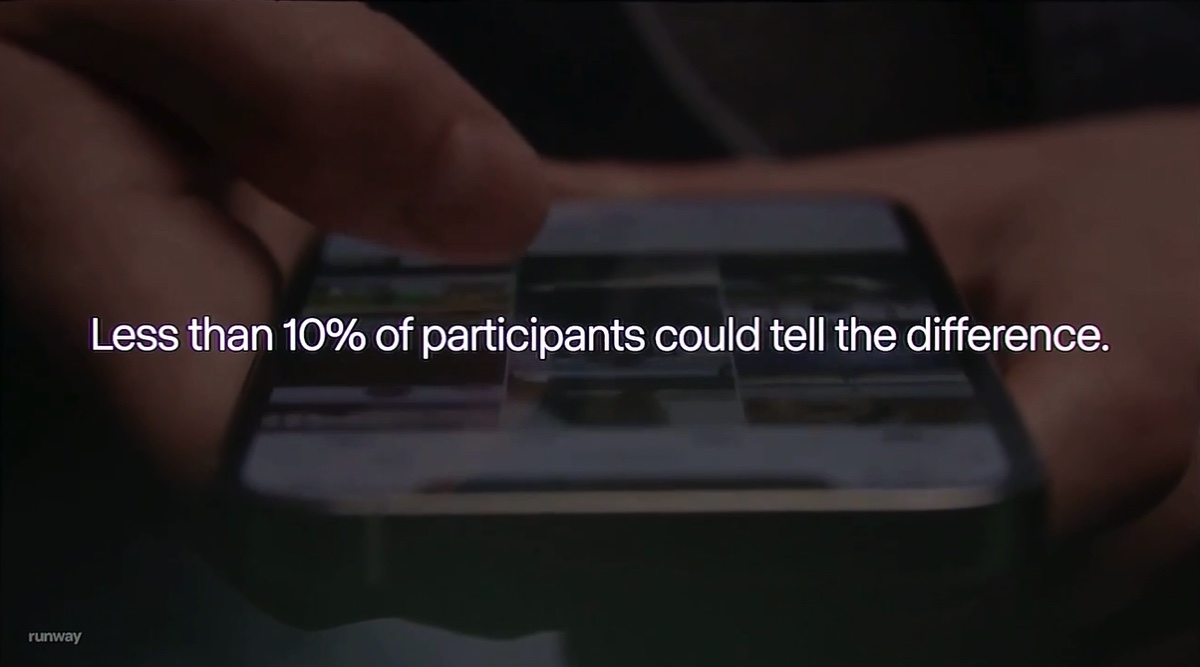

ゲルマニディス氏は、Genシリーズの品質テストについても話した。同氏らは同シリーズの生成動画品質を試すために、「現実世界を撮影した動画」と「その動画の最初のコマから生成された動画」を、人間の評価者に見比べてもらうテストを実施した。その結果、撮影動画と生成動画を区別できた人は、評価者全体の10%未満であった。Genシリーズは、現実世界と遜色のない動画を生成している、と言っても過言ではないのだ。

ゲルマニディス氏は、研究中のGenシリーズの応用方法にも言及した。そのなかのひとつとして、ロボットの訓練データの生成がある。ロボットの訓練データをめぐる問題として、失敗事例を収集するのが難しいことがある。こうした現実には収集が難しい動画データを、同シリーズを使って生成するのだ。

ゲルマニディス氏は、今後も単なる動画生成にとどまらない、Genシリーズの活用事例を研究して発信していく、と述べて発表を終えた。

以上に紹介した4つのセッションからわかるのは、生成AIは以前より活用が進んでいる動画やゲームに加えて、フィジカルAIを介して物理世界にも活躍の場を広げていることである。

生成AIが活躍の場を広げることは、そうしたAIを駆動させるのに不可欠なNVIDIAの製品がより広範に使われることを意味する。それゆえ、今後もNVIDIAの経済的繁栄は続くのではないだろうか。

(※1)NVIDIA GTC 2026

https://www.nvidia.com/ja-jp/gtc/

(※2)NVIDIA GTC 2026セッション「Build and Deploy AI Models and Agents for Media & Entertainment」

https://www.nvidia.com/ja-jp/on-demand/session/gtc26-s82144/

(※3)NVIDIA GTC 2026セッション「Revolutionize Automated Parcel Handling With Humanoid Robots」

https://www.nvidia.com/ja-jp/on-demand/session/gtc26-s81982/

(※4)NVIDIA GTC 2026セッション「Real-Time Generative Video Re-Styling for Gaming in the Next-Generation Datacenter」

https://www.nvidia.com/ja-jp/on-demand/session/gtc26-s81596/

(※5)NVIDIA GTC 2026セッション「Simulating Reality Inside General World Models」

https://www.nvidia.com/ja-jp/on-demand/session/gtc26-s82147/

Anthropicが明かすAI活用の“闇”とは——人工知能との会話がもたらす「認知機能の歪み」

2026年1月28日、AIチャットボットのClaudeシリーズを開発・提供するAnthropicは、「現実世界におけるAI活用に…