YouTubeが誤ってセキュリティ教育チャンネルを凍結 問われる不正動画自動検出の精度

存在すら知られていない削除動画も

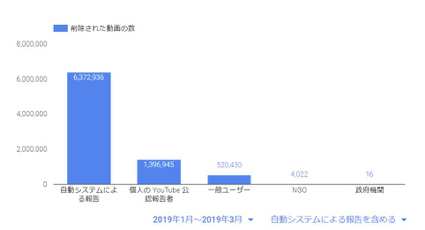

YouTubeは、動画削除の実態について「YouTube コミュニティガイドラインの適用について」という透明性レポートを公開している。このレポートを読むと、同サイトがいかに膨大な数の動画を削除しているかを知ることができる。

2019年1~3月に削除された動画チャンネルは約280万チャンネル、削除された動画は約830万本にも及ぶ。興味深いのは、削除された動画のうち75%を超える約640万本が「自動システムによる報告」によって検出されていることだ(下のグラフ参照)。前述したセキュリティ教育チャンネルも、自動システムによって検知されたのだろう。このシステムの詳細はレポートには明記されていないが、おそらくは画像認識や自然言語処理のような最新のAI技術が活用されていると推測できる。

レポートは自動システムによって削除対象と認識された動画のうち、75.7%が視聴される前に削除されていることも報告している。この事実には、内容が不適切な動画が誰の目にも触れずに消えていくという肯定的な側面がある。その一方で、YouTubeがどんな動画を削除したのかを知ることが著しく困難になっている側面もある。削除された動画の大半は、動画制作者とYouTube運営以外にはその存在すら知られることがないのだ。

削除された動画を確かめようがないことは、自動システムの削除処理を第三者が検証することが極めて困難なことも意味している。YouTubeひいてはGoogleの親会社にあたるAlphabetが掲げる行動規範の結論部分には、あの有名な「邪悪になるな」が明記されている。それゆえ、YouTubeがあからさまな政治目的で自動システムを運営するようなことはまずない。だがしかし、万が一、自動システムが何らかの政治的バイアスにもとづいて動作してしまったら、その誤作動に果たして社会は気づくだろうか。

以上のようにYouTubeにおける削除動画の一件について掘り下げると、テクノロジーによる管理体制に対する信頼という現代社会が直面している大きな問題に突き当たるのだ。そして、この問題に無関係なユーザはほとんどいないだろう。

トップ画像出典:YouTubeのTwitterアカウントよりロゴを引用

■吉本幸記

テクノロジー系記事を執筆するフリーライター。VR/AR、AI関連の記事の執筆経験があるほか、テック系企業の動向を考察する記事も執筆している。Twitter:@kohkiyoshi