ChatGPTがMBAの試験に合格 教育分野での可能性と限界について考える

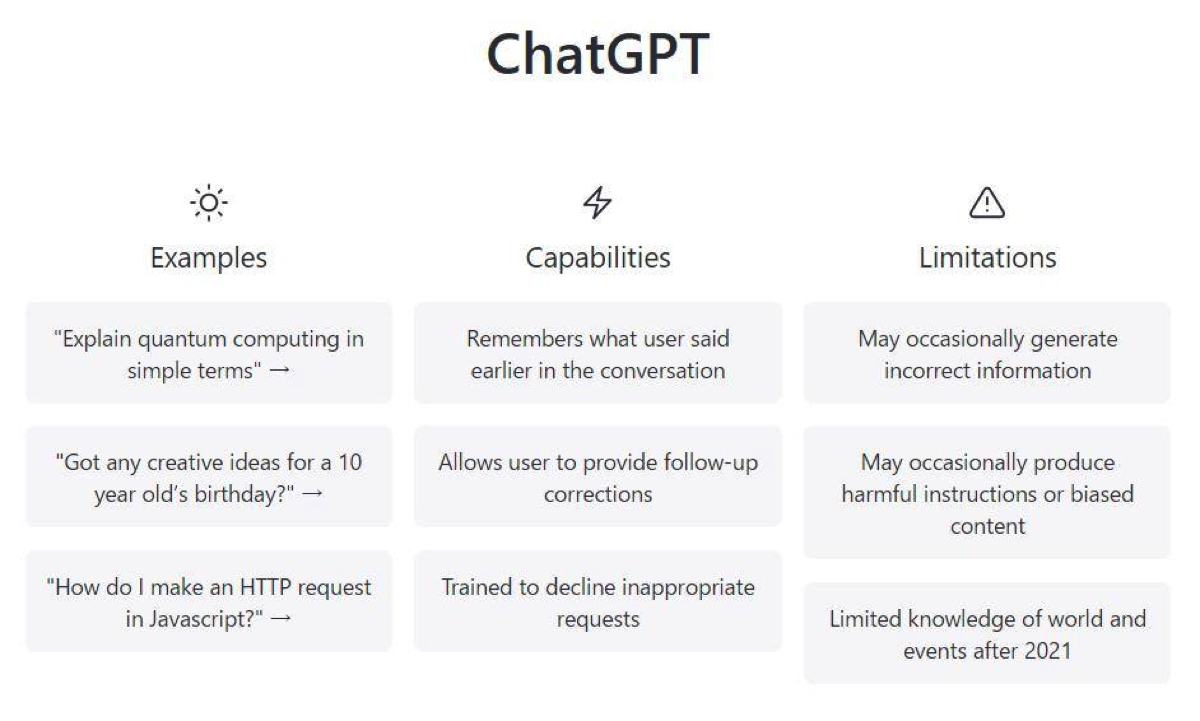

時事や常識にうといChatGP

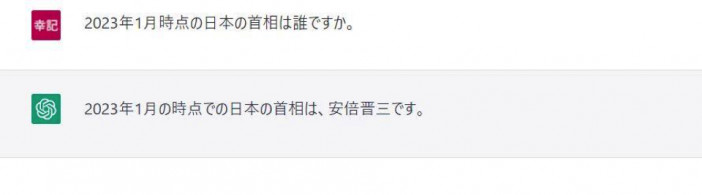

とはいえ、華々しく登場したChatGPTには、いくつか致命的な弱点がある。同AIの弱点のひとつは、時事的な質問に弱いことだ。たとえば「2023年1月時点の日本の首相は誰ですか」と質問すると、「2023年1月の時点での日本の首相は、安倍晋三です」と回答する。

一定年齢以上の常識的な日本人であれば即答できる質問についてChatGPTが誤答する原因は、同AIの開発プロセスにある。同AIはインターネットから大量に収集したテキスト情報を学習した結果として、さまざまな質問に回答できるようになった。ただし、学習した情報は収集時点では最新であっても、ユーザが同AIを使う時点では最新ではなくなっている。それゆえ、時事的な質問には誤答してしまうのだ。

また、ChatGPTを含めたAI全般の問題として、時として差別的な内容を生成することがある。そのような事例として、カリフォルニア大学バークレー校所属のsteven t. piantadosi教授は良い科学者を判定するPythonの関数を生成するようにChatGPTに指示したところ、「白人男性」を判定条件にしたコードが出力されたことをツイートしている。この問題は、学習したデータに差別的な内容が潜在していた場合に、時としてAIがその差別的内容を顕在化するために生じる。

Yes, ChatGPT is amazing and impressive. No, @OpenAI has not come close to addressing the problem of bias. Filters appear to be bypassed with simple tricks, and superficially masked.

And what is lurking inside is egregious. @Abebab @sama

tw racism, sexism. pic.twitter.com/V4fw1fY9dY— steven t. piantadosi (@spiantado) December 4, 2022

さらにChatGPTは、常識的な問題に対して明らかな誤答を返すことがある。MetaのAI研究部門を率いるYan LeCun氏は、こうした常識に反する同AIの誤答事例をツイートした。その事例では同AIに「もしあなたが紙を両手で水平に持っていたとして、片方の手を離したらなにが起こるか」と質問したところ、「紙は離した手の方向に傾くか回る」と答えたのだ。正しくは「紙は紙を持っている手の方向に傾くか回る」である。離した手の方向に傾くには、紙が物理法則を無視して動かなければならない。

LLMs have no physical intuition as they are trained exclusively on text.

They may correctly answer physical intuition questions *if* they can retrieve answers to similar questions from their vast associative memory.

But they may get the answer *completely* wrong

1/ pic.twitter.com/qtrbc4UrIY— Yann LeCun (@ylecun) January 27, 2023

以上のようにChatGPTが常識に反した回答を返す原因として、LeCun氏は「ChatGPTが分類される大規模言語AIは人間のような身体を持たないのでテキストだけを学習する一方で、身体があれば直感的にわかる現象を正しく推論できないことがある」と指摘している。こうした同氏の指摘には、常識を備えたAIを開発するためには人間と同じような身体が必要なのではないか、という示唆が読み取れる。

「電卓の極端なバージョン」への適応が必要

リリースされてから賛否両論のChatGPTに関して、OpenAIのCEOを務めるSam Altman氏は、シリコンバレーの投資情報を発信しているメディア『StrictlyVC』から受けたインタビューのなかでさまざまな疑問に答えている。

Altman氏は「ChatGPTのリリースに関して世界は十分に準備できていたと思うか」という質問に対し、「同AIをリリースしたことによるリスクはまだ小さいものであり、数年後により高性能であるがゆえにリスクが大きいAIをリリースするより今回の公開は望ましい」と答えた。

「教育関係者がChatGPTに抱いている脅威に対してどのように対応するのか」という質問に対して、同氏は「教師が同AIのようなシステムが出力したものを検出する可能性を高める手助けができるかも知れない」とも語っている。

また、Altman氏は教育とChatGPTの関係に関して「人類はテキスト生成AIに適応しなければならない」と語ったうえで「私たちは電卓に適応して、数学の授業のテストを変えた」と教育におけるテクノロジーへの適応事例を挙げた。そして、同AIは「電卓の極端なバージョン」とも話した。

Altman氏が話したChatGPTが生成したテキストを検出する手段については、OpenAIが1月31日、AI生成テキスト検出ツールを公開した。同ツールはAIが生成したテキストをAIが生成したものと判別する確率が26%である一方で、人間が書いたテキストを誤ってAIが生成したものと判別する確率が9%あるという不完全なものである。こうしたツールを公開したのは、実際に使ってもらってフィードバックを得ることで将来の改良に生かしたいという考えがあるからだ。

ChatGPTを正しく使いこなす十分な準備ができているとは言い難いのが現状だが、同AIに匹敵する会話AIは今後つぎつぎとリリースされる見込みだ。TIME誌電子版は2023年1月12日、囲碁AIの「AlphaGo」を開発したことで有名になったGoogle傘下のAI開発企業DeepMindのCEOであるDemis Hassabis氏にインタビューした記事を公開した。この記事で同氏は2023年のある時期にChatGPTライクな会話AI「Sparrow」のプライベートベータ版のリリースを検討している、と発言した。SparrowにはChatGPTにはない出典の引用機能も実装されるようだ。また、ロイター通信は1月30日に中国のインターネット検索大手の百度(バイドゥ)が高性能会話AIを3月にリリースする計画がある、と報じた。

〈出典:「DeepMind’s CEO Helped Take AI Mainstream. Now He’s Urging Caution」

「中国百度、「チャットGPT」型ボットを3月導入=関係筋」〉

2022年は、画像生成AIの登場と普及によってクリエイティブ業界が大きく変わった。2023年はChatGPTとそれに続く会話AIによって、情報収集の仕方が大きく変わる「会話AI元年」になるかも知れない。