AIに関する“3つの観点”にもとづいて比較した「GoogleとOpenAIの動向」

毎年5月に開催されるGoogleの開発者会議『Google I/O』は、今年は日本時間2024年5月15日から2日間の日程でおこなわれた。今回の会議も例年通り、AIに関する発表が中心となっていた。

そうした発表は膨大かつ多岐にわたるのだが、本稿では「基盤モデル」「Android」「クリエイティブAI」という3つの観点からまとめていく。そのうえで、AI開発におけるGoogleの最大のライバルであるOpenAIの動向と比較もしていきたい。

2時間の動画を分析できるようになったGemini

『Google I/O 2024』においてもっとも重要な発表は、Googleが開発する基盤モデル「Gemini」がアップデートされたことだ。簡単に説明しておくと、基盤モデルとはさまざまな用途に使われる高性能AIのことであり、言わば「AIサービスのOS」に相当する。

Geminiに関する発表は、GoogleのAI研究を担っている子会社・DeepMindのデニス・ハサービスCEO執筆の記事にまとめられている(※1)。Geminiは2023年12月、性能が低いが軽量かつスタンドアローンで動作可能なNano、Nanoより高性能なPro、最上位モデルUltraの3モデルが発表され、2024年2月には「Gemini 1.5 Pro」が公開された。今回の発表では、1.5 Proがアップデートされるとともに、新たなモデル「Gemini 1.5 Flash」も公開された。

順番に解説していこう。アップデートされた「Gemini 1.5 Pro」は、「コンテキストウィンドウ」が200万まで拡大された。コンテキストウィンドウとは1度に処理できる情報量を意味しており、この値が200万まで拡大されたことで「140万の単語を含む文書」や「2時間の動画」といった大きなデータを処理できるようになった。

「Gemini 1.5 Pro」で出来ることを知るには、2024年2月の発表時に公開されたデモ動画が参考になる。動画ではサイレント映画時代に活躍した喜劇俳優バスター・キートンが出演している44分の映画について、「ポケットから紙が出される瞬間を見つけて、その紙に書かれている重要な情報をタイムコード(再生時間)とともに教えてください」と質問をすると、同AIは適切に回答を返してくる。こうした動画に関する質問が、2時間の長編映画でも可能となったのだ。

もっとも、以上の「Gemini 1.5 Pro」を利用できるのはウェイティングリストにユーザー登録した開発者と、「Google Cloud」のユーザーに限定される。一般ユーザーはコンテキストウィンドウが100万のバージョンのみ利用でき、使うには有料の対話型AIサービス「Gemini Advanced」に加入する必要がある(※2)。

新登場した『Gemini 1.5 Flash』は、主にAPIを介してツールに組み込んで利用する開発者向けのものである。このAIは要約、チャット、画像や動画のキャプション、長い文書や表からのデータ抽出など頻繁に実行されるタスクを効率よく実行するために開発されている。

1.5 Flashの登場にあわせて、GeminiをさまざまなGoogleサービスで活用していくことも発表された。たとえばGoogle検索では、検索結果としてAIが生成した回答が表示されるようになる(※3)。こうした生成検索はアメリカから提供がはじまり、近日中にさらに多くの国で使えるようになる予定だ。また、GmailやGoogleドキュメントをパッケージ化してAIで強化した「Gemini for Google Workspace」も、Gemini 1.5 Proに対応した(※4)。

AIがGoogleフォトから画像を探してくれる「Ask Photos」も発表

GeminiがAndroidと連携して、Androidスマホでさまざまな新機能を使えるようになることも発表された。そうした新機能のうちで注目すべきものを、以下に3つ挙げる。

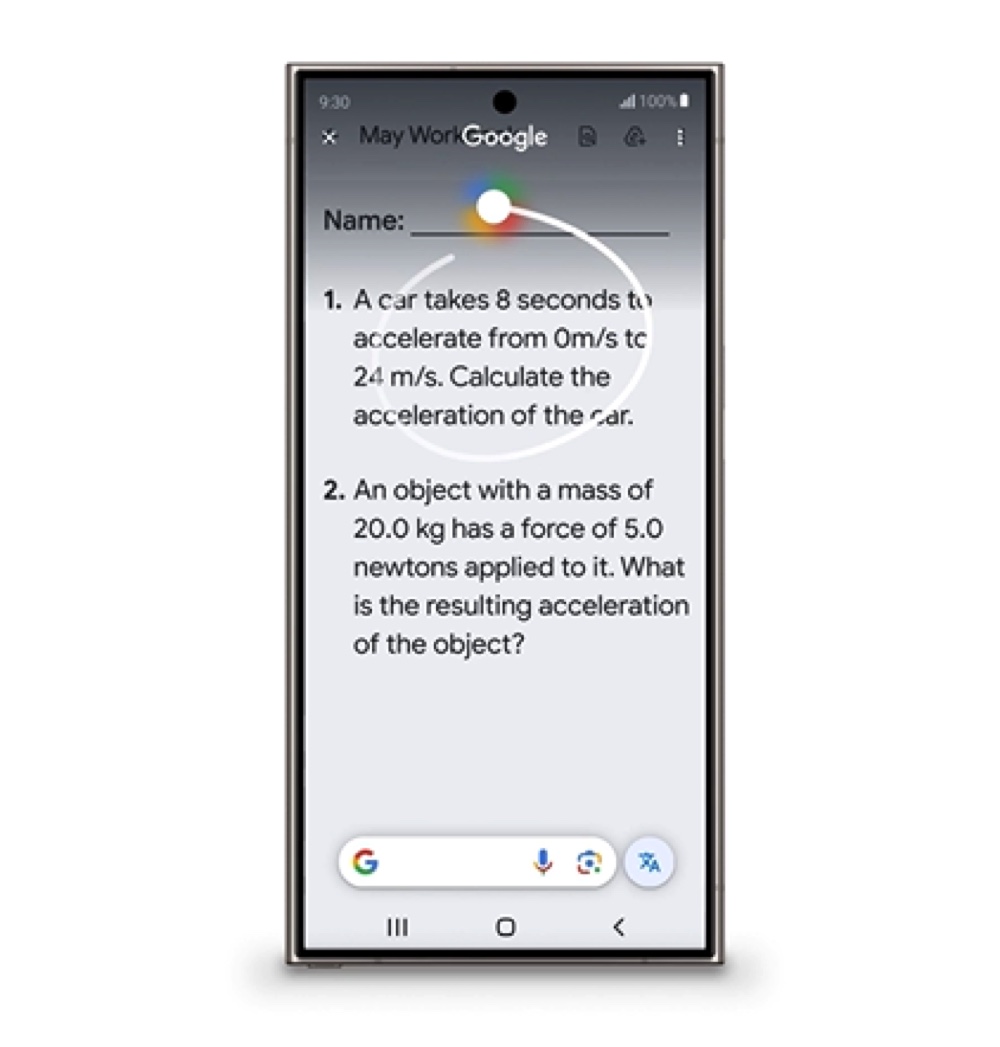

すでに『Google Pixel 6』以降の機種や「Galaxy S21」シリーズ以降の機種で利用可能な「かこって検索」は、Geminiを教育用にカスタマイズしたLearnLMと連携するようになる(※5)。その結果、例えば学校の宿題に対してかこって検索を使うと、宿題を解くための手順が表示される。今年の後半には図やグラフを含む問題の解決もサポートするようになる。

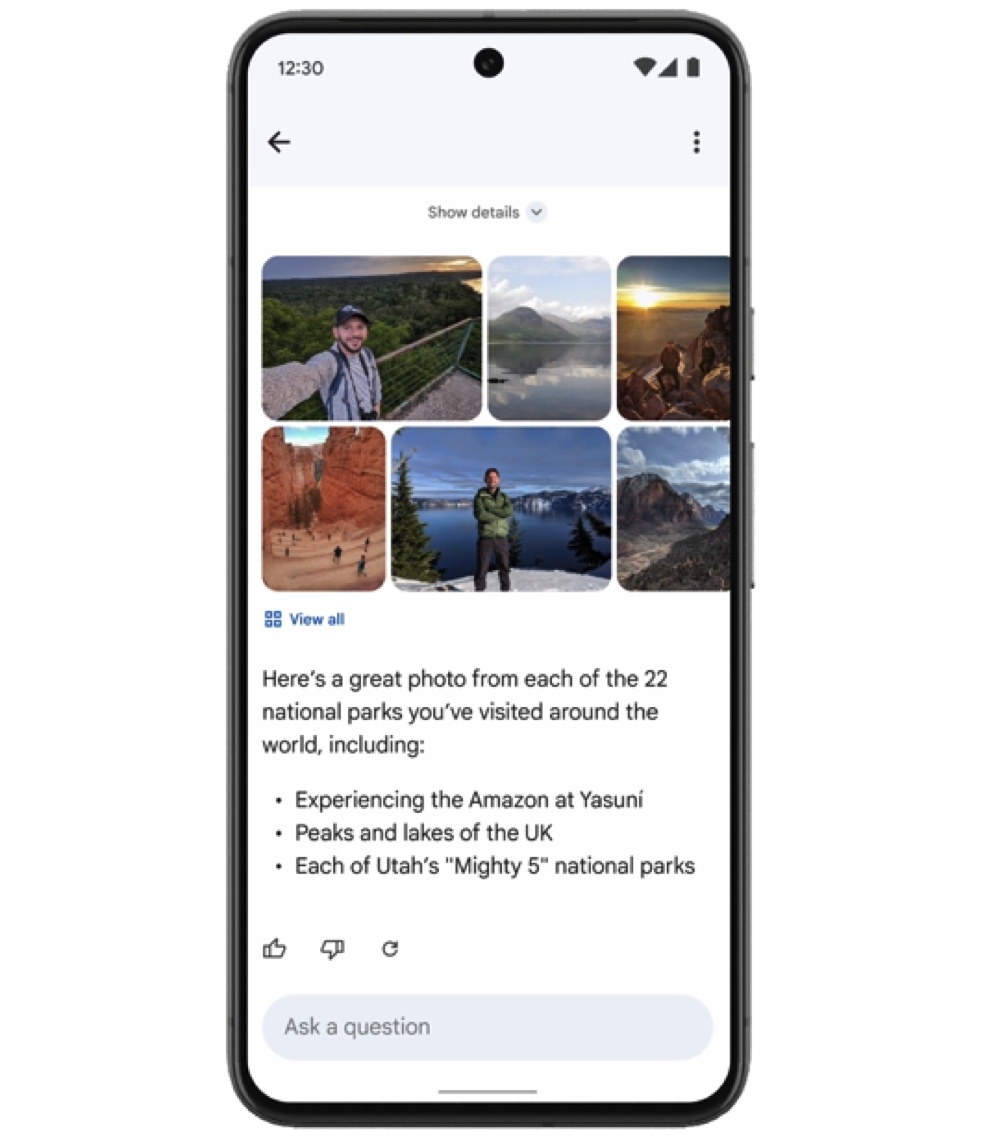

「Ask Photos(日本語名称未定)」は、Googleフォトに保存した画像をAIが探してくれるサービスだ(※6)。例えば「過去に訪問した22のアメリカ国立公園で撮影した画像からいいものを選んで」のようにAIに指示すると、指示に沿った画像を収集して表示してくれる。この機能は、数ヶ月以内に利用可能となる見込みだ。

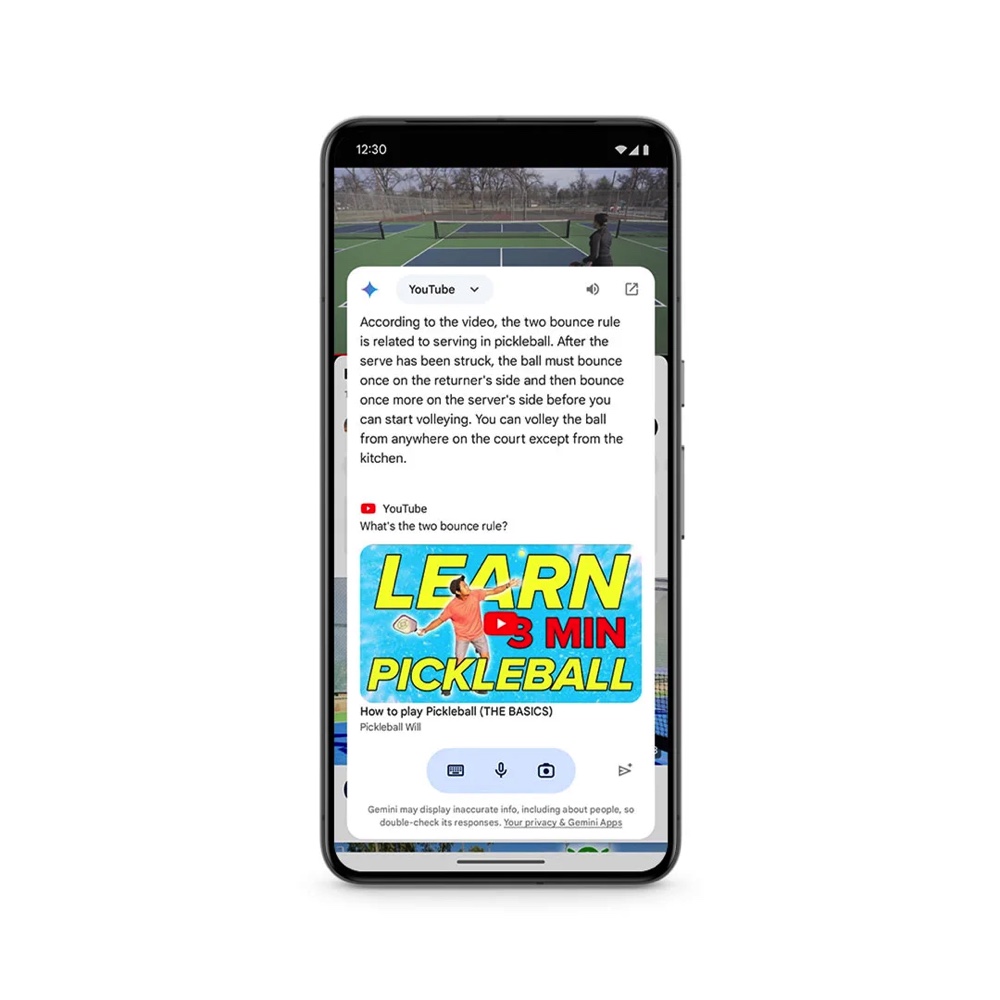

Andoridスマホの画面に表示された内容の理解を助けるオーバーレイ機能も、同様に数ヶ月以内に利用可能となる(※7)。この機能を使えば、たとえばYouTubeで視聴しているスポーツ動画に関するルールの解説を、オーバーレイして(つまり、既存の画面にさらに重ねて)表示する。オーバーレイされた情報は、Geminiによって生成されている。